La Declaración Pro-Humana Propone Un Marco Urgente para la IA Responsable en Medio de Vacío Regulatorio

Una coalición bipartidista lanza la *Declaración Pro-Humana*, un marco vital para la *IA responsable* que busca llenar el vacío regulatorio actual.

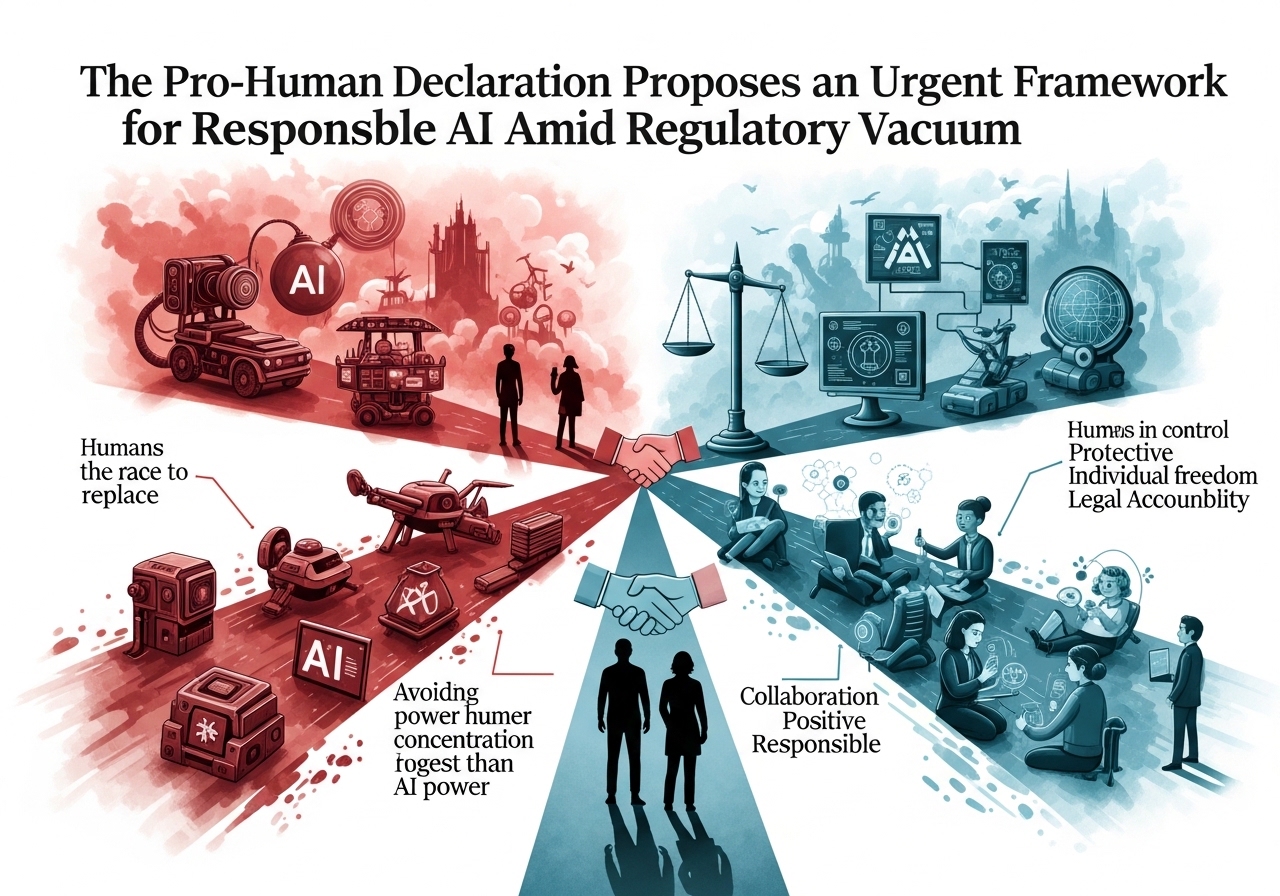

El reciente y tenso enfrentamiento entre el Pentágono y la empresa de IA Anthropic, que culminó con la designación de esta última como "riesgo en la cadena de suministro", ha dejado en evidencia una cruda realidad: la asombrosa falta de normativas coherentes que rijan el desarrollo de la inteligencia artificial. Mientras Washington titubea, una coalición bipartidista de mentes brillantes ha dado un paso al frente para proponer lo que el gobierno no ha logrado: un marco claro para un desarrollo de IA verdaderamente responsable.Este esfuerzo ha materializado la "Declaración Pro-Humana", un documento revolucionario que fue finalizado incluso antes del conflicto entre el Pentágono y Anthropic, pero cuya urgencia se magnificó con el incidente. Max Tegmark, el reconocido físico del MIT e investigador de IA, y uno de los organizadores de esta iniciativa, señaló la creciente preocupación pública: "Las encuestas muestran de repente que el 95% de los estadounidenses se opone a una carrera sin regulación hacia la superinteligencia".La declaración, respaldada por cientos de expertos, exfuncionarios y figuras públicas, arranca con una observación directa: la humanidad se encuentra en una encrucijada. Un camino, denominado "la carrera por reemplazar", nos lleva a ser sustituidos primero como trabajadores y luego como tomadores de decisiones, a medida que el poder se concentra en instituciones irresponsables y sus máquinas. El otro camino, y el que promueve la declaración, es el de una IA que amplía masivamente el potencial humano. Este futuro deseado se asienta sobre cinco pilares fundamentales: mantener a los humanos al mando, evitar la concentración de poder, proteger la experiencia humana, preservar la libertad individual y responsabilizar legalmente a las empresas de IA.Entre las provisiones más contundentes de la declaración, se destaca la prohibición explícita del desarrollo de superinteligencia hasta que exista un consenso científico sobre su seguridad y un respaldo democrático genuino. También exige interruptores de apagado obligatorios en sistemas potentes y prohíbe arquitecturas capaces de autorreplicación, auto-mejora autónoma o resistencia al cierre. La necesidad de estas medidas se hizo palpable el último viernes de febrero, cuando el Secretario de Defensa Pete Hegseth clasificó a Anthropic, cuyo software ya opera en plataformas militares clasificadas, como un "riesgo en la cadena de suministro" tras su negativa a conceder al Pentágono un uso ilimitado de su tecnología. Horas después, OpenAI llegó a un acuerdo con el Departamento de Defensa, que, según expertos, será difícil de aplicar de manera efectiva. Esto dejó al descubierto el alto costo de la inacción del Congreso en materia de IA.Como explicó Dean Ball, del Foundation for American Innovation, a The New York Times, "Esto no es solo una disputa contractual. Es la primera conversación que tenemos como país sobre el control de los sistemas de IA". Tegmark, utilizando una analogía que todos podemos entender, compara la situación con la regulación farmacéutica: "Nunca te preocupas de que una empresa farmacéutica libere un medicamento que cause daños masivos antes de que la gente haya descubierto cómo hacerlo seguro, porque la FDA no les permite liberar nada hasta que sea lo suficientemente seguro".Curiosamente, Tegmark cree que el punto de presión más probable para desencadenar cambios legislativos es la seguridad infantil. La declaración exige pruebas obligatorias antes del despliegue de productos de IA, especialmente chatbots y aplicaciones de compañía dirigidas a usuarios jóvenes, cubriendo riesgos como el aumento de la ideación suicida, la exacerbación de condiciones de salud mental y la manipulación emocional. “Si un anciano espeluznante le envía mensajes de texto a una niña de 11 años, fingiendo ser una joven e intentando persuadir a este niño para que se suicide, el tipo puede ir a la cárcel por eso”, dijo Tegmark. “Ya tenemos leyes. Es ilegal. Entonces, ¿por qué es diferente si una máquina lo hace?”.Lo verdaderamente extraordinario es que figuras tan dispares como el exasesor de Trump, Steve Bannon, y la exasesora de Seguridad Nacional de Obama, Susan Rice, han firmado el mismo documento, junto con el expresidente del Estado Mayor Conjunto, Mike Mullen, y líderes religiosos progresistas. "Lo que tienen en común, por supuesto, es que todos son humanos", afirma Tegmark. "Si se trata de decidir si queremos un futuro para los humanos o un futuro para las máquinas, por supuesto que estarán del mismo lado". Esta convergencia de ideas subraya la universalidad de la preocupación y la necesidad urgente de acción.