Samsung presenta avances en memorias HBM4 para acelerar servidores de IA en 2026

El fabricante mostró prototipos HBM4 y planes de producción, buscando mejorar ancho de banda y eficiencia energética en IA.

Calificación

0 / 5 (0 votos)

Fuente: https://images.pexels.com/photos/18069814/pexels-photo-18069814.png?auto=compress&cs=tinysrgb&h=650&w=940

Categoría: Tecnología

Samsung volvió a poner el foco en el “cuello de botella” más comentado de la industria: la memoria que alimenta a las GPU en centros de datos. Este 20 de febrero de 2026, la compañía detalló avances en su hoja de ruta de memorias de alto ancho de banda (HBM4), un componente clave para sostener el crecimiento de la IA generativa y el entrenamiento de modelos cada vez más grandes.

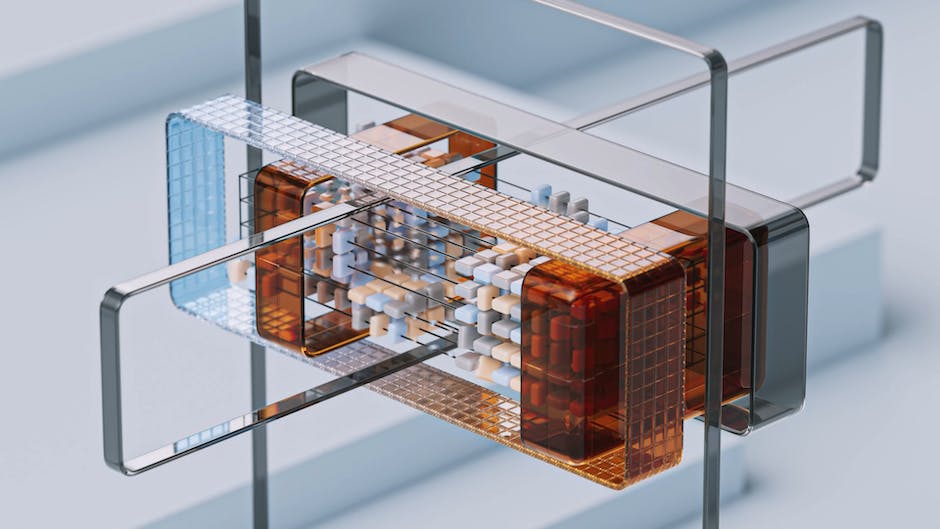

La idea detrás de HBM es sencilla de explicar, aunque compleja de fabricar: apilar varios chips de memoria y conectarlos con vías verticales para que trabajen como un bloque muy rápido y eficiente. En la práctica, ese diseño permite mover más datos por segundo entre la memoria y el procesador, algo crítico cuando una GPU está calculando miles de millones de operaciones y necesita acceso constante a parámetros, activaciones y lotes de entrenamiento.

Según la información presentada por la empresa, el salto a HBM4 apunta a dos objetivos: más ancho de banda y mejor eficiencia energética por bit transferido. En centros de datos, esa combinación se traduce en menos tiempo de entrenamiento y, sobre todo, en una reducción del costo operativo asociado a energía y refrigeración. La presión por mejorar estos números es real: el gasto eléctrico se ha convertido en una de las principales barreras para escalar infraestructura de IA, especialmente en regiones donde la red está al límite o la energía es más cara.

El anuncio llega en un momento de competencia intensa entre proveedores de memoria y fundiciones. La demanda de HBM se ha disparado por el despliegue de aceleradores para IA en la nube y por la carrera de grandes tecnológicas por ampliar capacidad. En ese contexto, los fabricantes están ajustando calendarios, asegurando contratos de suministro y afinando procesos para elevar rendimiento de fabricación (yield), uno de los factores que más impacta el precio final.

Samsung también subrayó que trabaja en estrecha coordinación con socios del ecosistema —diseñadores de GPU, integradores de servidores y operadores de nube— para validar compatibilidad, empaquetado avanzado y comportamiento térmico. En memorias apiladas, la temperatura importa: a mayor densidad y velocidad, más difícil es disipar calor sin afectar estabilidad.

Aunque la compañía no presentó cifras definitivas de disponibilidad comercial para todos los clientes, sí dejó claro que 2026 será un año de transición en el que los prototipos y las primeras tandas de producción marcarán la diferencia. Si HBM4 cumple lo prometido, el impacto será directo: más rendimiento por rack y una infraestructura de IA que escala con menos fricción.

Referencias: comunicado corporativo de Samsung Semiconductor y cobertura sectorial de medios como Reuters y The Korea Economic Daily sobre la carrera por HBM en 2026.