Wikipedia Dibuja una Línea Roja: La IA Queda Fuera

En una decisión que resuena en todo el ecosistema digital, la versión en inglés de Wikipedia ha actualizado sus directrices para prohibir de forma explícita el uso de Grandes Modelos de Lenguaje (LLM) para la creación de artículos. Con una votación aplastante de 40 a 2, la comunidad de editores ha enviado un mensaje claro: la mayor enciclopedia del mundo elige ser un baluarte del conocimiento generado por humanos, en un internet cada vez más saturado de contenido artificial.

La nueva política es tajante: "El texto generado por grandes modelos de lenguaje (...) suele infringir varias de las políticas fundamentales de contenido de Wikipedia". Estas políticas son el pilar sobre el que se construye la fiabilidad de la plataforma: la neutralidad, la verificabilidad a través de fuentes fiables y la prohibición de investigaciones originales. En esencia, la IA, en su estado actual, no puede garantizar estos principios.

¿Existen Zonas Grises? Las Excepciones a la Norma

Aunque la prohibición es firme, Wikipedia contempla dos escenarios muy específicos donde la asistencia de la IA está permitida, siempre bajo estricta supervisión humana:

- Sugerencias y correcciones de estilo: Se puede usar un LLM para pulir la redacción o corregir errores gramaticales básicos. Sin embargo, se advierte a los editores que deben ser cautelosos, ya que estas herramientas a menudo “van más allá de lo que se les pide y alteran el significado del texto”.

- Traducción de artículos: Es posible usar IA para traducir contenido de un idioma a otro, pero con una condición innegociable: un editor humano competente en ambos idiomas debe revisar minuciosamente el resultado para asegurar su precisión y fidelidad. Este punto es crucial, dado que Wikipedia ya ha enfrentado problemas en el pasado por traducciones automáticas de baja calidad.

El Valor de lo Humano en un Océano Sintético

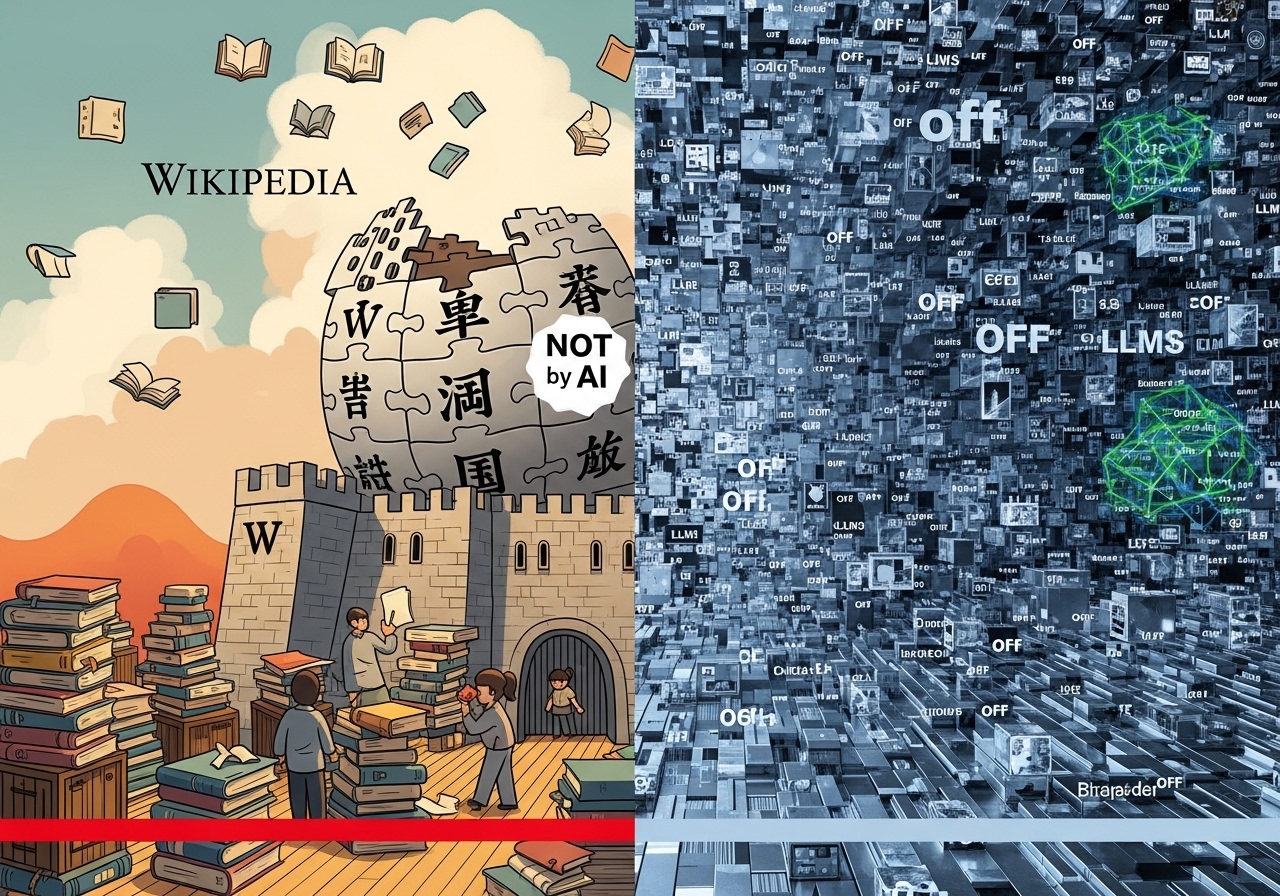

La decisión de Wikipedia no es un mero ajuste técnico; es una declaración de principios. En un momento en que distinguir entre lo auténtico y lo sintético se ha vuelto una tarea casi imposible, la enciclopedia se posiciona como una reserva de contenido genuinamente humano. Es la apuesta por la autoría y la responsabilidad como garantía de fiabilidad.

Resulta irónico que, mientras Wikipedia rechaza activamente a la IA, los modelos de inteligencia artificial continúan entrenándose con el vasto conocimiento que sus editores humanos han acumulado durante décadas. La IA bebe de la fuente que ahora le cierra la puerta, consumiendo recursos de sus servidores sin, en muchos casos, redirigir tráfico a la plataforma original.

La Corriente Anti-IA: Más Allá de Wikipedia

Este movimiento no es aislado. Está surgiendo una corriente global que busca preservar los espacios humanos en la red. Artistas que diseñan intencionadamente con “imperfecciones” para diferenciarse de la estética pulida y homogénea de la IA, extensiones de navegador que filtran los resultados de búsqueda generados artificialmente y la popularización de la insignia 'Not by AI' son prueba de ello.

El caso de Etsy es un ejemplo paradigmático del problema. Lo que nació como un mercado de productos artesanales y únicos se ha visto inundado de artículos de bajo coste generados por IA, a menudo haciéndose pasar por obras hechas a mano. Aunque la plataforma exige etiquetar dicho contenido, la norma se ignora masivamente, demostrando que las etiquetas por sí solas no son una solución.

El Gran Desafío: ¿Cómo Detectar al Infractor?

El punto más complejo de la nueva política de Wikipedia es su aplicación. ¿Cómo se podrá demostrar que un editor ha utilizado IA? La propia organización admite la dificultad en sus directrices: “Es posible que algunos editores tengan estilos de redacción similares a los de los modelos de lenguaje grande”.

Reconocen que para justificar una sanción se necesitarán “más pruebas que meros indicios estilísticos o lingüísticos”. Dado que las herramientas de detección de texto generado por IA son notoriamente poco fiables, Wikipedia se enfrenta a un enorme desafío para hacer cumplir su propia regla. La lucha por un internet más humano apenas comienza, y el campo de batalla está lleno de incógnitas.